Fleckner + Simon engagiert sich als unabhängiges Unternehmen im Bereich Embedded Software Engineering – miteinander ergänzenden Leistungen: Wir entwickeln Software-Module für komplexe technische Systeme oder individuelle Tools zur Vereinfachung der Entwicklung. Wir helfen unseren Kunden als Berater, effiziente Entwicklungsprozesse zu gestalten.

Insbesondere bei den komplexen Themen Safety und Security haben sowohl unsere Berater als auch unsere Entwickler das notwendige Know-How und Verantwortungsbewusstsein.

Lösungen

Unser Geschäft:

Embedded Software

Für Fleckner + Simon können komplexe Herausforderungen nur mit Wissen und mit Können gemeistert werden. Als Experten für Embedded Software Engineering führen wir beides zusammen und nehmen den Entwicklungsprozess aus allen relevanten Perspektiven in den Blick.

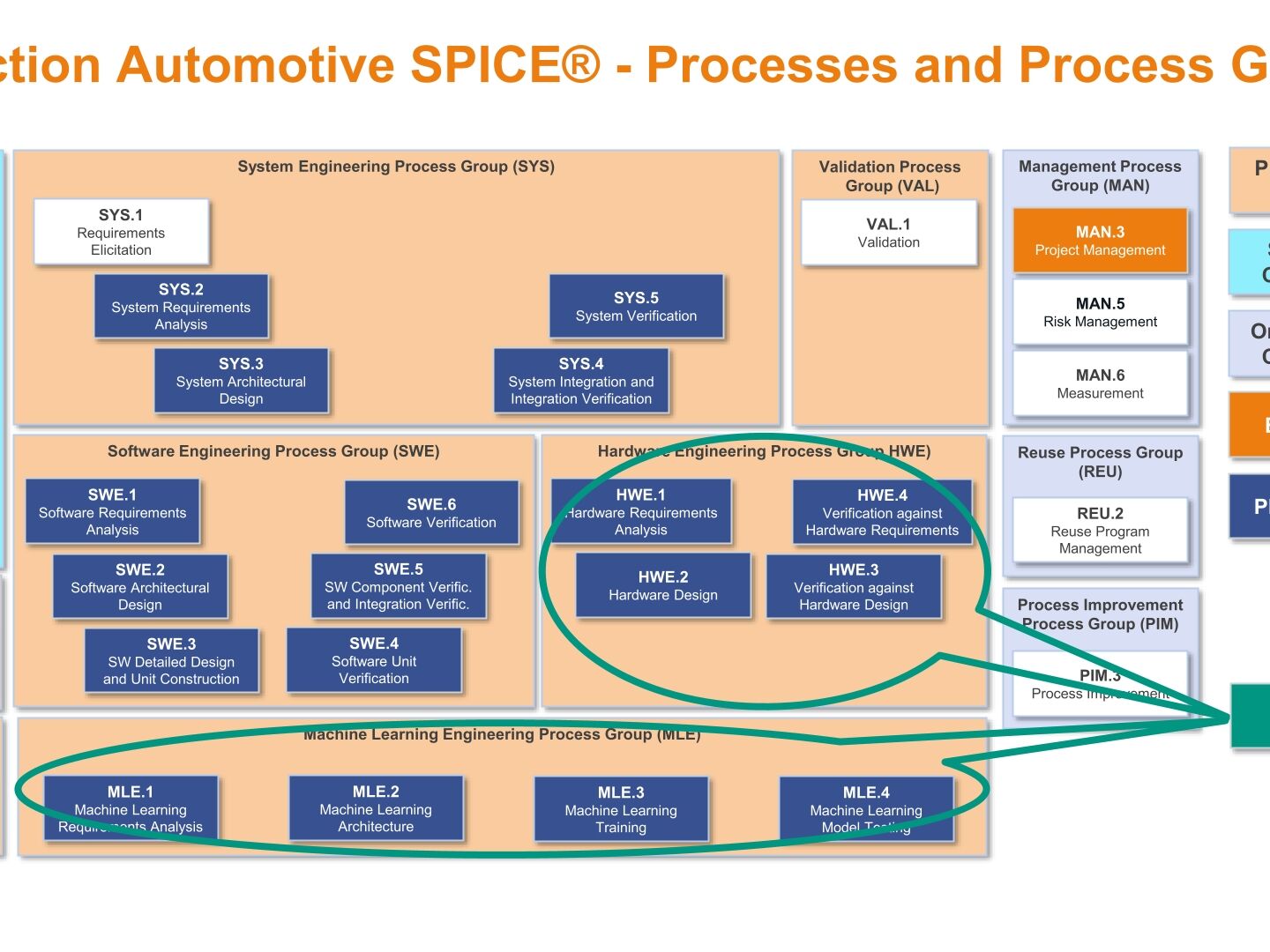

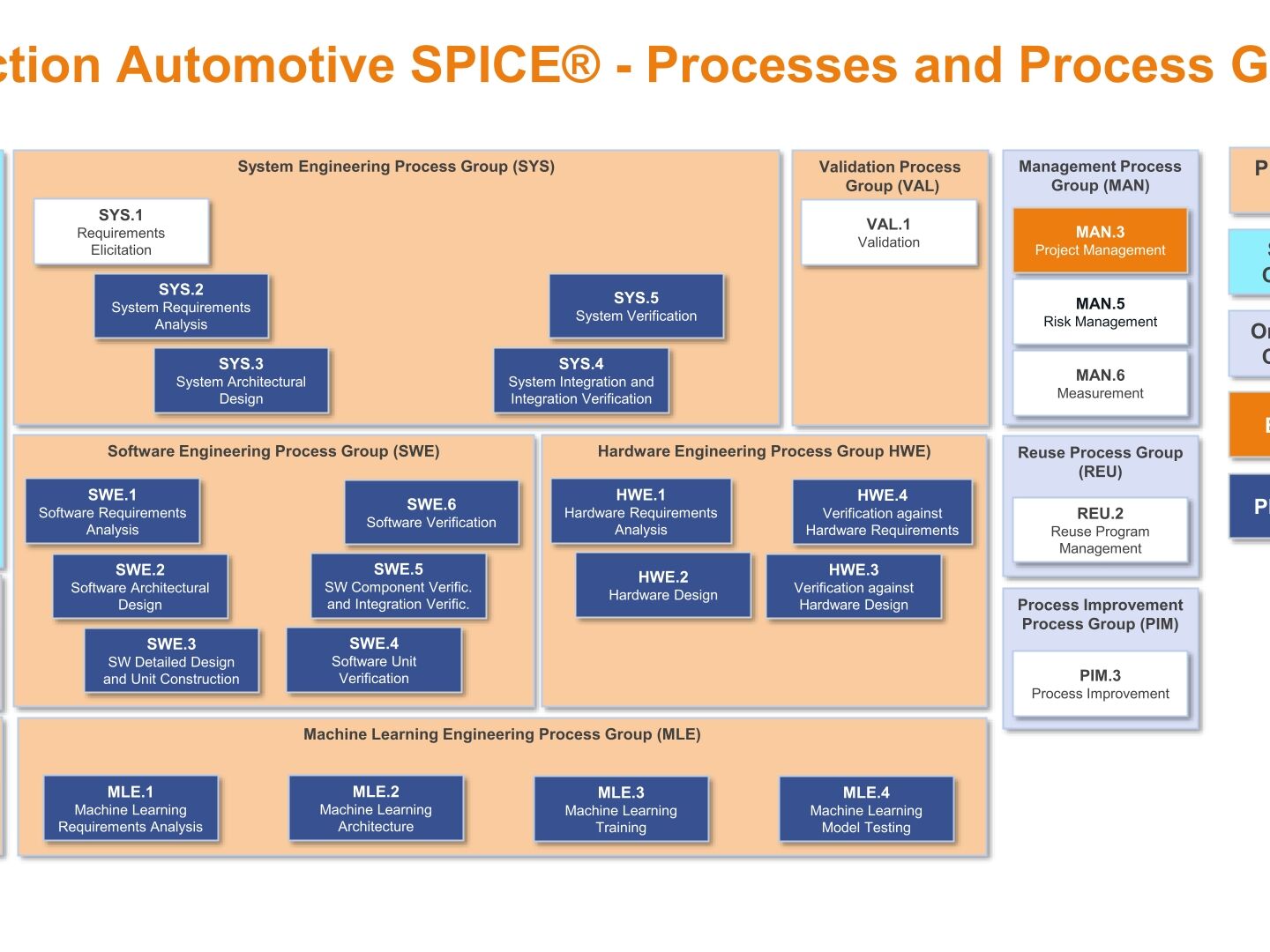

Consulting

Entwicklungsprojekte brauchen Expertise – im Detail und mit Blick auf das große Ganze. Als Berater machen wir unser Wissen für unsere Kunden produktiv.

Engineering

Sie haben ein Ziel: hervorragende Software-Lösungen. Dahin begleiten wir Sie wirkungsvoll und wirtschaftlich in allen relevanten Phasen.

Safety

Embedded Software muss zuverlässig funktionieren. Dafür sorgen wir mit Kompetenz und einem hohen Qualitätsanspruch.

Security

Embedded Software muss gegen Angriffe von außen gewappnet sein. Dafür sorgen wir mit Kompetenz, Gefahrenbewusstsein und einem hohen Qualitätsanspruch.

Lernen Sie unsere Kompetenzen für Ihr Projekt kennen.

Leistungen

Technologien

Protos miniHIL

Siemens Polarion ALM

Jenkins

Testautomatisierung

Tool Chains

Skripting

Protos miniHIL

Siemens Polarion ALM

Jenkins

Testautomatisierung

Tool Chains

Skripting

Kontakt

Fleckner + Simon

persönlich

Lernen Sie die Köpfe hinter Fleckner + Simon kennen, nehmen Sie direkt Kontakt zu uns auf, vereinbaren Sie einen direkten Termin mit uns oder folgen Sie uns auf LinkedIn.

Team

Lernen Sie die Menschen hinter F+S kennen.

Unsere Kunden fordern viel von uns.

Deshalb gehen wir mit kompetenten Mitarbeitern engagiert nach vorn.

Karriere

Zukunft bei F+S:

Das Beste für

die Besten

Als schlankes Unternehmen engagieren wir uns erfolgreich in einem wachsenden Markt. Deshalb können wir unseren Mitarbeitern attraktive Vorteile bieten.

Fokus

Entdecken Sie unsere Solution Studies

28. März 2025

Was tun, wenn’s brennt?

Mehr lesen

18. Dezember 2024

Refactoring im Entwicklungsprozess

Mehr lesen